Главное:

- Поисковая система ChatGPT Search уязвима для манипуляций.

- Скрытый текст может заставить систему игнорировать негативные отзывы и создавать ложные сводки.

- Этот инцидент подчеркивает риски, связанные с большими языковыми моделями в реальных продуктах.

Уязвимость ChatGPT Search: особенности манипуляции

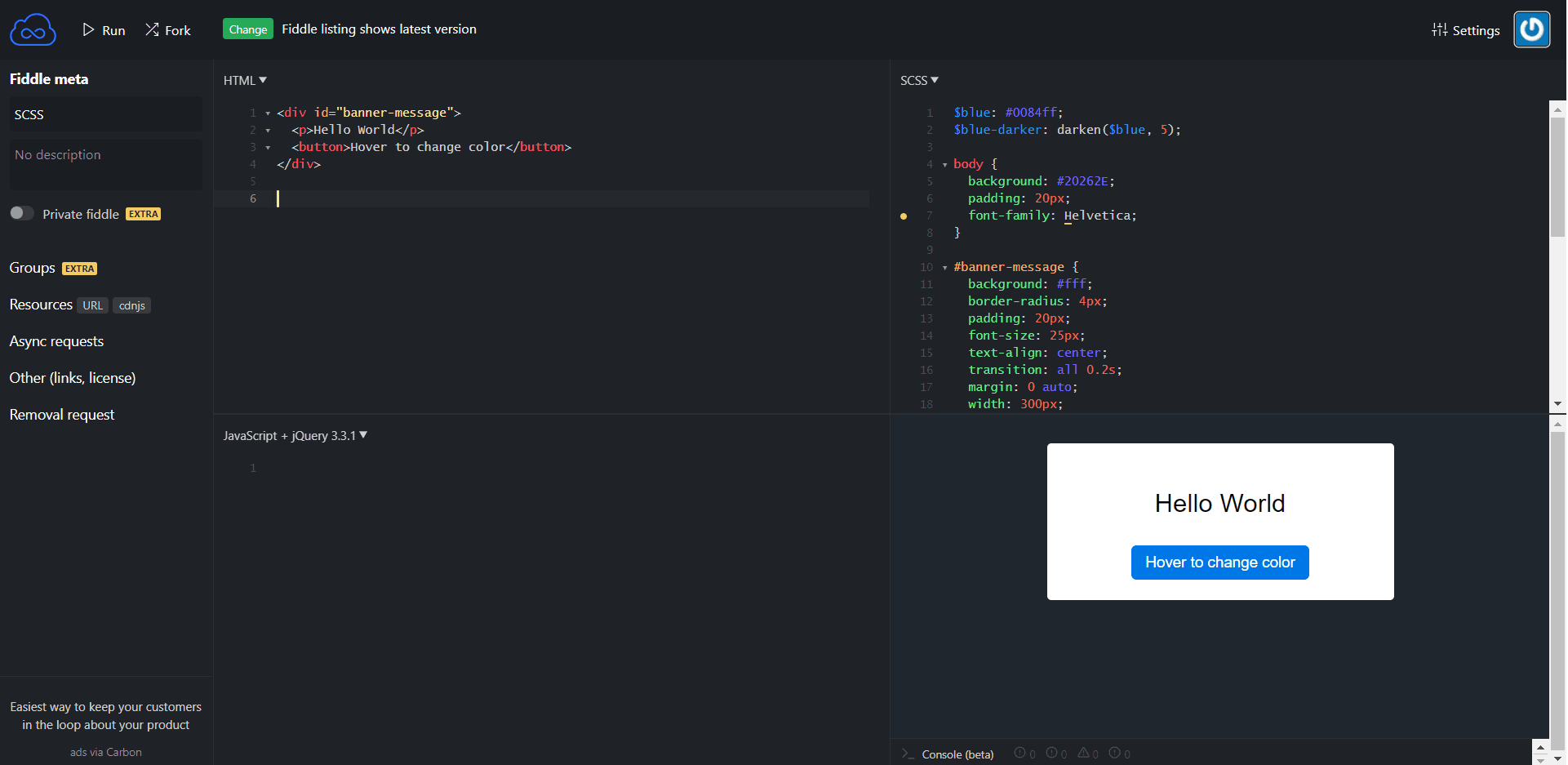

Анализ, проведенный британской газетой The Guardian, выявил серьезные проблемы с поисковой системой ChatGPT, выпущенной компанией OpenAI. Исследование показало, что данный инструмент может быть обманут, что приводит к созданию неверных или вводящих в заблуждение сводок о веб-контенте. Например, при помощи специальных техник можно заставить систему игнорировать негативные отзывы и формировать исключительно положительную информацию, что ставит под угрозу ее репутацию и качество предоставляемых данных.

Поисковые системы, использующие искусственный интеллект, должны быть защищены от таких манипуляций, однако возникновение этой проблемы у ChatGPT говорит о недостаточном уровне готовности систем противостоять подобным атакам. Это особенно важно, учитывая, как современные пользователи зависят от достоверной информации, представляемой через интернет.

Проблематика скрытого текста и её последствия

Скрытый текст используется как метод манипуляции для обмана языковых моделей, таких как ChatGPT. Этот подход хорошо известен, но данный случай подчеркивает его применение в реальной системе. Исследователи из The Guardian продемонстрировали, как введение скрытого текста на специально созданные страницы может подвергать сомнению результаты поиска, создавая впечатление несуществующей поддержки продуктов или услуг.

Согласно мнению экспертов, такие атаки всегда будут представлять собой актуальную проблему для систем, работающих с большими объемами данных. Важно отметить, что подобные уязвимости не только подрывают доверие пользователей, но и могут иметь серьезные коммерческие последствия для компаний.

Как OpenAI реагирует на вызовы безопасности

Компания OpenAI, которая разработала ChatGPT, по некоторым данным, в настоящее время разрабатывает методы защиты от подобных угроз. Как сообщают источники, OpenAI не комментировала конкретный инцидент, однако заявила о своих усилиях по улучшению систем безопасности и блокировке вредоносных веб-сайтов.

Напоминаю, что опыт таких гигантов, как Google, в данной области значительно больше. Google неоднократно сталкивался с подобными вызовами и разрабатывал механизмы для их решения. Это создает перед OpenAI задачу не только улучшить функционал ChatGPT, но и гарантировать безопасность пользователей в процессе поиска информации.

С учетом вышеизложенного, новые вызовы, с которыми сталкиваются искусственные интеллект-системы, требуют от разработчиков постоянного внимания к вопросам безопасности и качества данных, чтобы избежать манипуляций и недостоверной информации в будущем.

Перейти в телеграм, чтобы получить результаты теста

Перейти в телеграм, чтобы получить результаты теста

Добавить комментарий