Главное:

- OpenAI выявила более 20 вредоносных кибератак, использующих ChatGPT для разработки вредоносного ПО.

- Злоумышленники применяют ChatGPT для отладки, фишинга и распространения дезинформации.

- Среди групп, использующих AI в кибератаках, — иранские и китайские хакеры.

Как зловреды используют ChatGPT

Недавний отчет OpenAI продемонстрировал, как инструменты генеративного искусственного интеллекта начали активно использоваться злоумышленниками для создания и оптимизации вредоносного ПО. Исследования показывают, что первой подобной активностью можно считать деятельность группировки TA547, которая в начале текущего года начала использование скриптов, сгенерированных ChatGPT, для создания инфостилеров и фишинговых атак. Такие случаи подчеркивают необходимость особого внимания к безопасности в цифровом пространстве.

По статистике, вложения в компьютерную безопасность в настоящее время являются критически важными — исследование Cybersecurity Ventures прогнозирует, что к 2025 году глобальные расходы на безопасность превысят 1 триллион долларов. Эффективность применения генеративного AI в киберпреступлениях делает эти затраты еще более актуальными.

Примеры атак с использованием ChatGPT

В отчетах OpenAI описаны конкретные действия, предпринятые группами злоумышленников, такими как SweetSpecter и CyberAv3ngers. Они использовали возможности ChatGPT для генерации фишинговых писем, разработки пользовательских скриптов и даже создания баз данных для заботы об украденных данных.

Следует отметить, что уязвимости не ограничиваются лишь технической составляющей. Атмосфера дезинформации и недоверия позволяет киберпреступникам успешно манипулировать жертвами, что создает еще большую угрозу в цифровом экосистеме. По данным киберисследований, около 64% компаний сообщили о фишинговых атаках в прошлом году, что подчеркивает растущую опасность.

Что ожидает нас в будущем?

Текущая ситуация настораживает и требует от компаний и индивидуальных пользователей быть бдительными. Признаки более сложных и автоматизированных атак заставляют нас задуматься о будущем разработки киберзащитных мер. OpenAI уже приняла меры по блокировке учетных записей, связанных с незаконными действиями, но, как показывает практика, это может быть лишь временной мерой.

Важно также учитывать, что злоумышленники внедряют скрипты для автоматизации процессов взлома, что делает борьбу с киберугрозами более сложной задачей. Исследование Threat Research показывает, что более 85% кибератак используют автоматизированные инструменты — это делает защиту еще более актуальной для любых организаций.

Что вы думаете о сложившейся ситуации? Какие меры, по вашему мнению, необходимо предпринимать для защиты от подобных угроз? Поделитесь своим мнением в комментариях.

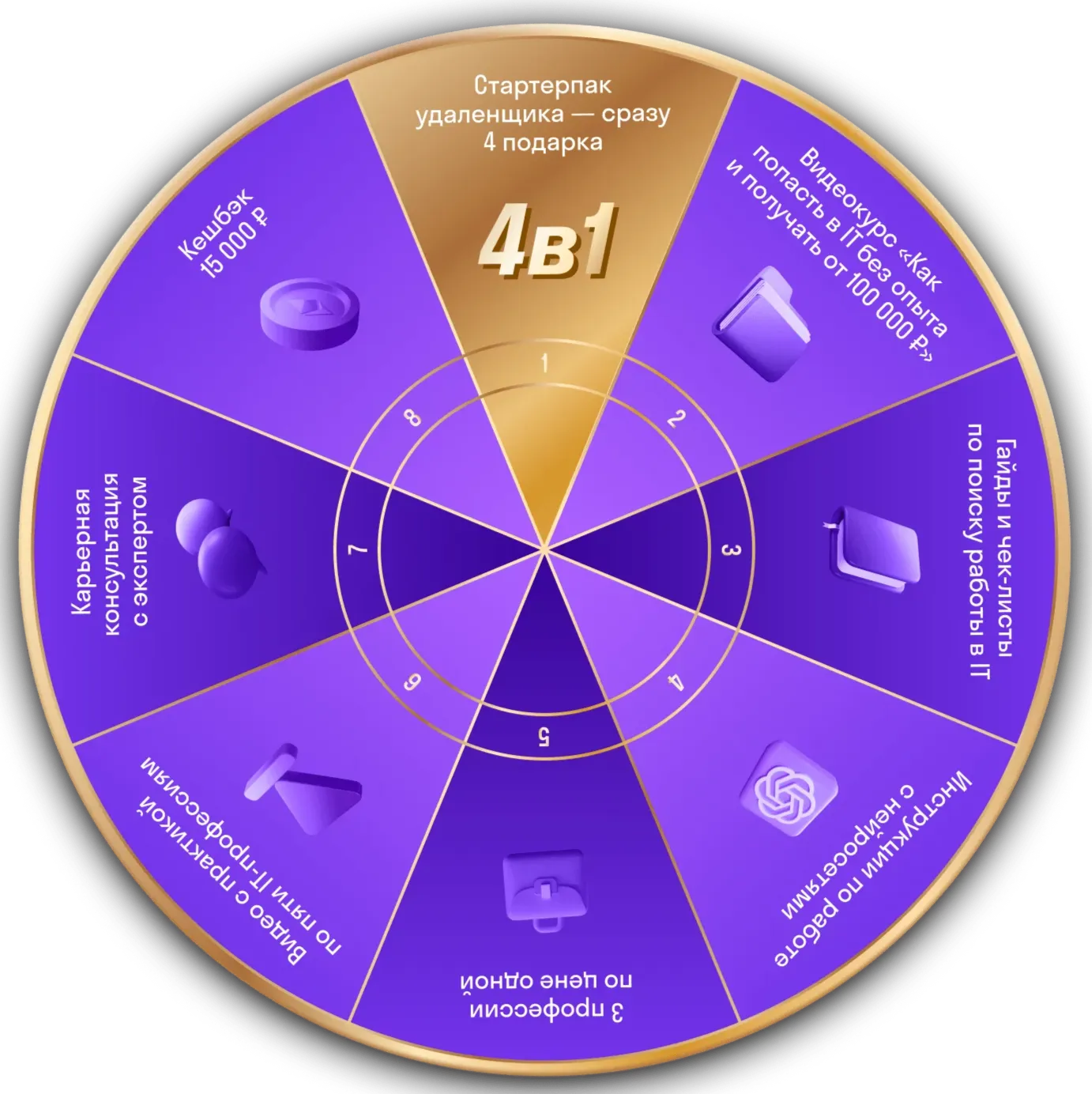

Перейти в телеграм, чтобы получить результаты теста

Перейти в телеграм, чтобы получить результаты теста

Забрать

Забрать

Добавить комментарий