Главное:

- Microsoft и OpenAI начали расследование возможного использования украденных данных для обучения модели DeepSeek.

- Группа, связанная с DeepSeek, извлекала значительные объемы данных через OpenAI API без разрешения.

- Администрация США выражает обеспокоенность по поводу возможных последствий безопасности из-за действий DeepSeek.

Расследование Microsoft и OpenAI

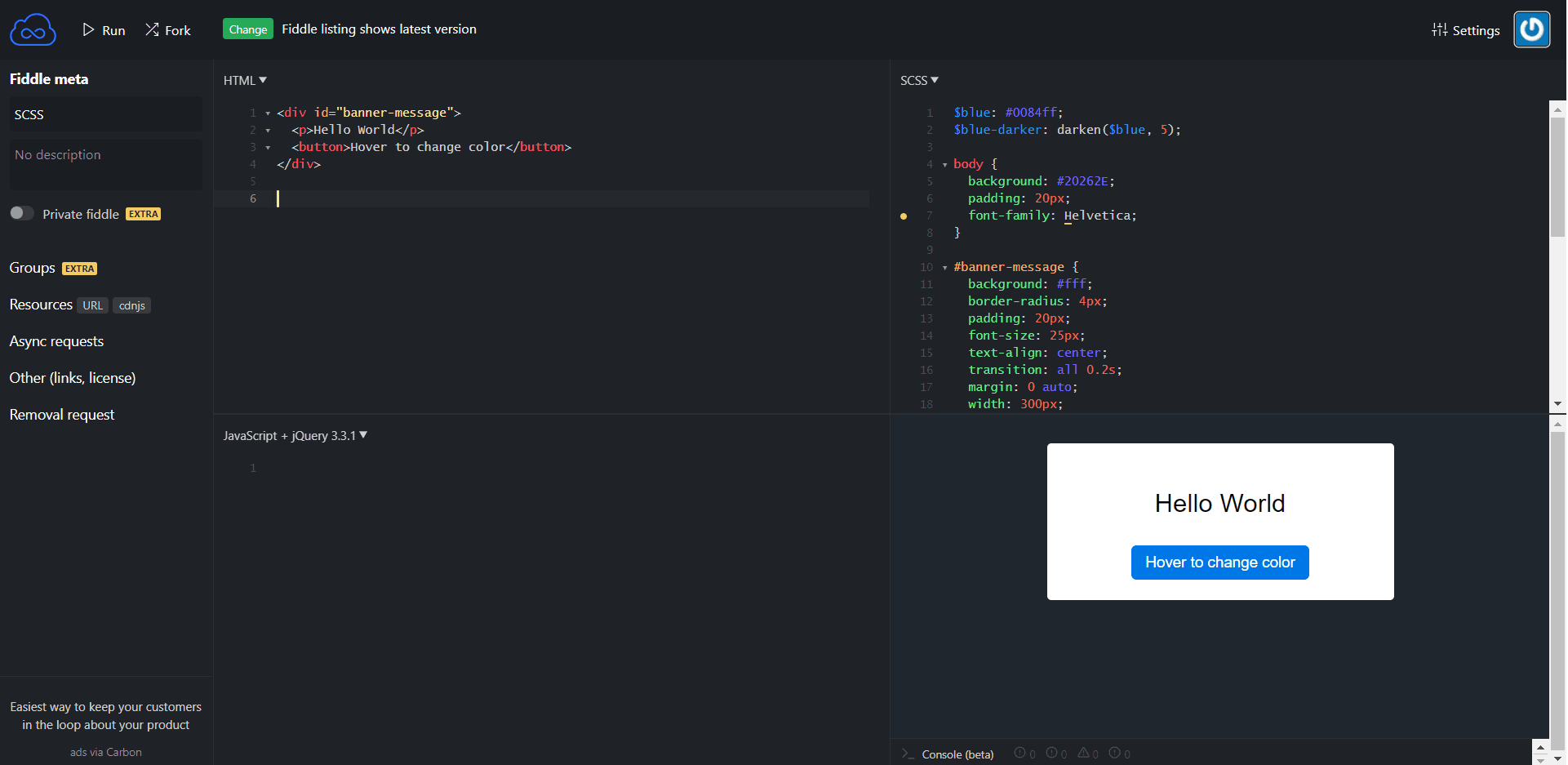

Недавние события в мире искусственного интеллекта привлекли внимание не только участников этого рынка, но и государственных органов США. По информации зарубежных СМИ, компании Microsoft и OpenAI начали расследование в связи с возможным использованием украденных данных для обучения модели DeepSeek. В частности, исследователи безопасности Microsoft зафиксировали, что лица, связанные с DeepSeek, могли без разрешения извлечь большие объемы данных с помощью API OpenAI. Эта ситуация поднимает важные вопросы о безопасности данных и соблюдении правил использования технологий.

Обвинения и возможные последствия

Проблема усугубляется тем, что представители администрации США предположили, что DeepSeek могла обучить свою модель на основе моделей OpenAI, используя метод дистилляции. Это вызывает серьезные опасения не только у экспертов в области искусственного интеллекта, но и у представителей правительственных структур, обеспокоенных возможными последствиями для национальной безопасности. В свете этой ситуации важно отметить, что задержки в регулировании и защите интеллектуальной собственности могут привести к значительным потерям для американских компаний и национальной экономики в целом.

Проблемы с данными пользователей

Согласно политике конфиденциальности DeepSeek, этот ИИ-сервис собирает и хранит различные данные пользователей, такие как IP-адреса, шаблоны нажатий клавиш и прочую личную информацию. Это вызывает дополнительные вопросы о конфиденциальности и безопасности данных, которые пользователи могут доверить этому сервису. Согласно опросам, более 60% пользователей обеспокоены, что их данные могут быть использованы без их ведома. Возможное нарушение правил использования и недобросовестная практика сбора данных подчеркивают необходимость более строгого контроля над ИИ-решениями и используемыми ими методами.

Перейти в телеграм, чтобы получить результаты теста

Перейти в телеграм, чтобы получить результаты теста

Забрать

Забрать

Добавить комментарий