Главное:

- Исследование показывает, что небольшой качественный набор данных и управление вычислениями могут значительно улучшить работу AI-моделей.

- Языковая модель s1-32B успешно демонстрирует высокие результаты в решении математических задач, несмотря на меньший объем данных.

- Метод «бюджетного принуждения» позволяет моделям лучше контролировать свои вычислительные процессы и повышать точность ответов.

Инновации в обучении языковых моделей

Недавнее исследование, проведенное учеными из Стэнфорда и Института искусственного интеллекта Аллена, выявило, что оптимизированный набор данных и гибкие методы управления при обучении могут кардинально изменить подход к разработке языковых моделей. В частности, модель s1-32B, обладающая 32 миллиардами параметров, была обучена на 1000 тщательно подобранных примеров из общего числа 60 000. Эти примеры соответствовали строгим стандартам сложности, разнообразия и качества. Попробуйте представить, что большинство существующих моделей используют тысячи часов работы, в то время как s1-32B смогла пройти подготовку всего за 26 минут на современном оборудовании. Это наглядно демонстрирует важность выбора правильного объема и качества данных для успешного обучения моделей.

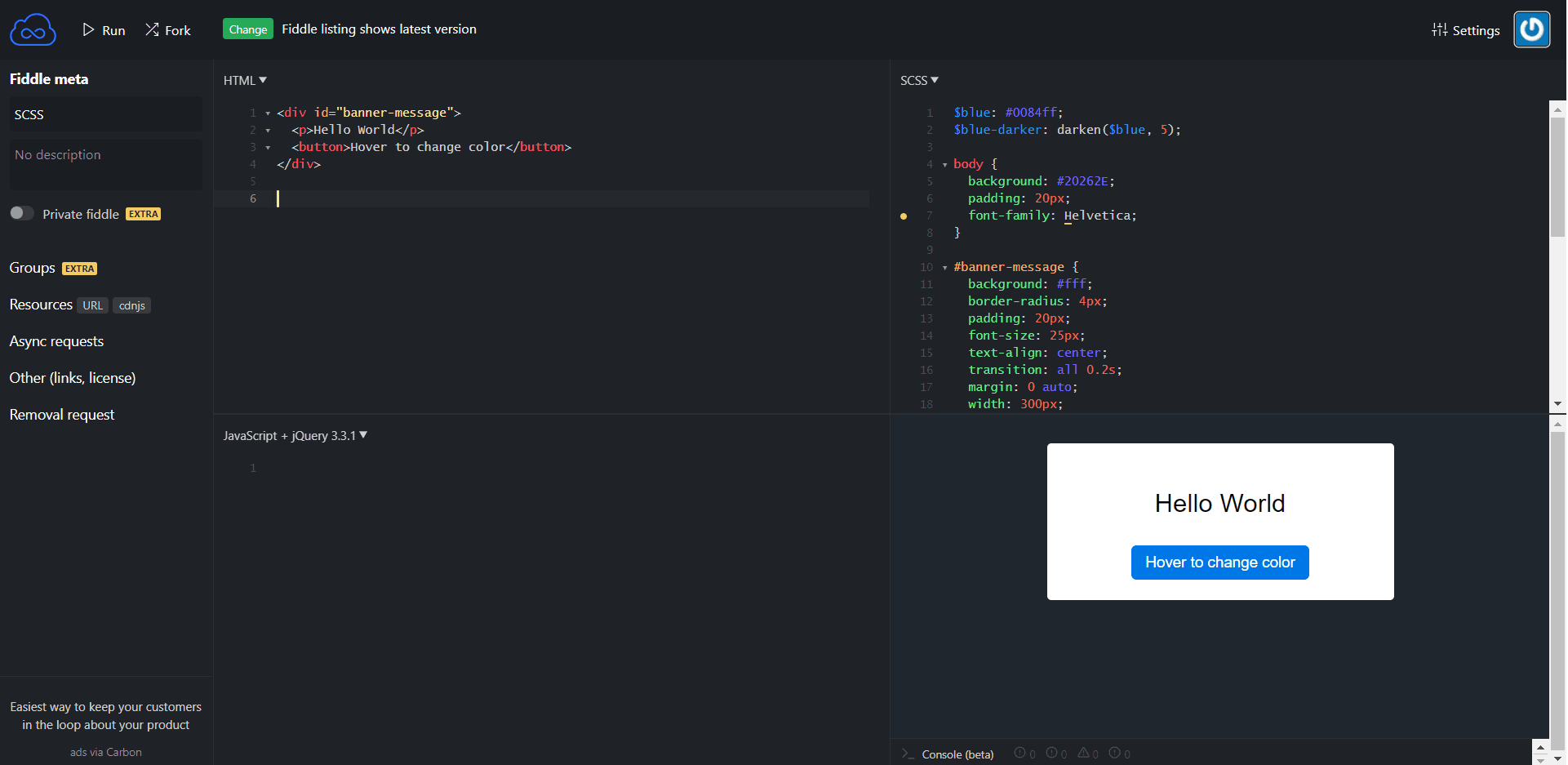

Метод «бюджетного принуждения»

Одним из ключевых аспектов данного исследования стал предложенный метод, известный как «бюджетное принуждение». Он позволяет менеджерам моделей оптимизировать вычислительные ресурсы, диктуя ограниченное время на решение задачи. Если модель превосходит установленное количество вычислительных шагов, она получает команду «Подождите», что предлагает ей пересмотреть свои ответы и конкретизировать Успешные модели, использующие этот подход, показали впечатляющие результаты в математике, что является значительным прорывом. Это подчеркивает, как важна возможность гибко реагировать на вычислительный процесс для достижения лучших результатов.

Эффективность при меньших затратах

Нет сомнений, что использование небольших, но высококачественных наборов данных, в сочетании с гибкими вычислительными стратегиями, является открытием в области искусственного интеллекта и языковых моделей. Интересно, что даже когда исследователи протестировали полноценный набор данных, в 59 раз превышающий количество использованных примеров, результаты не ухудшились. Это подтверждает, что не всегда объем данных определяет успех работы модели, а его тщательный отбор. Такие подходы могут привести не только к экономии времени, но и к более качественному решению сложных задач в различных областях науки, бизнеса и технологий.

Подводя итог, можно заключить, что оптимизация процесса обучения языковых моделей с акцентом на качественные данные и гибкие методы управления может привести к впечатляющим результатам, что открывает новые горизонты для использования AI в насущных задачах.

Перейти в телеграм, чтобы получить результаты теста

Перейти в телеграм, чтобы получить результаты теста

Забрать

Забрать

Добавить комментарий