Главное:

- Исследование выявило склонность ИИ Whisper к галлюцинациям в 1% случаев транскрипции.

- Система используется более 30 тысячами врачей и 40 медицинскими учреждениями.

- Проблемы с точностью транскрипции особенно заметны при взаимодействии с пациентами, страдающими афазией.

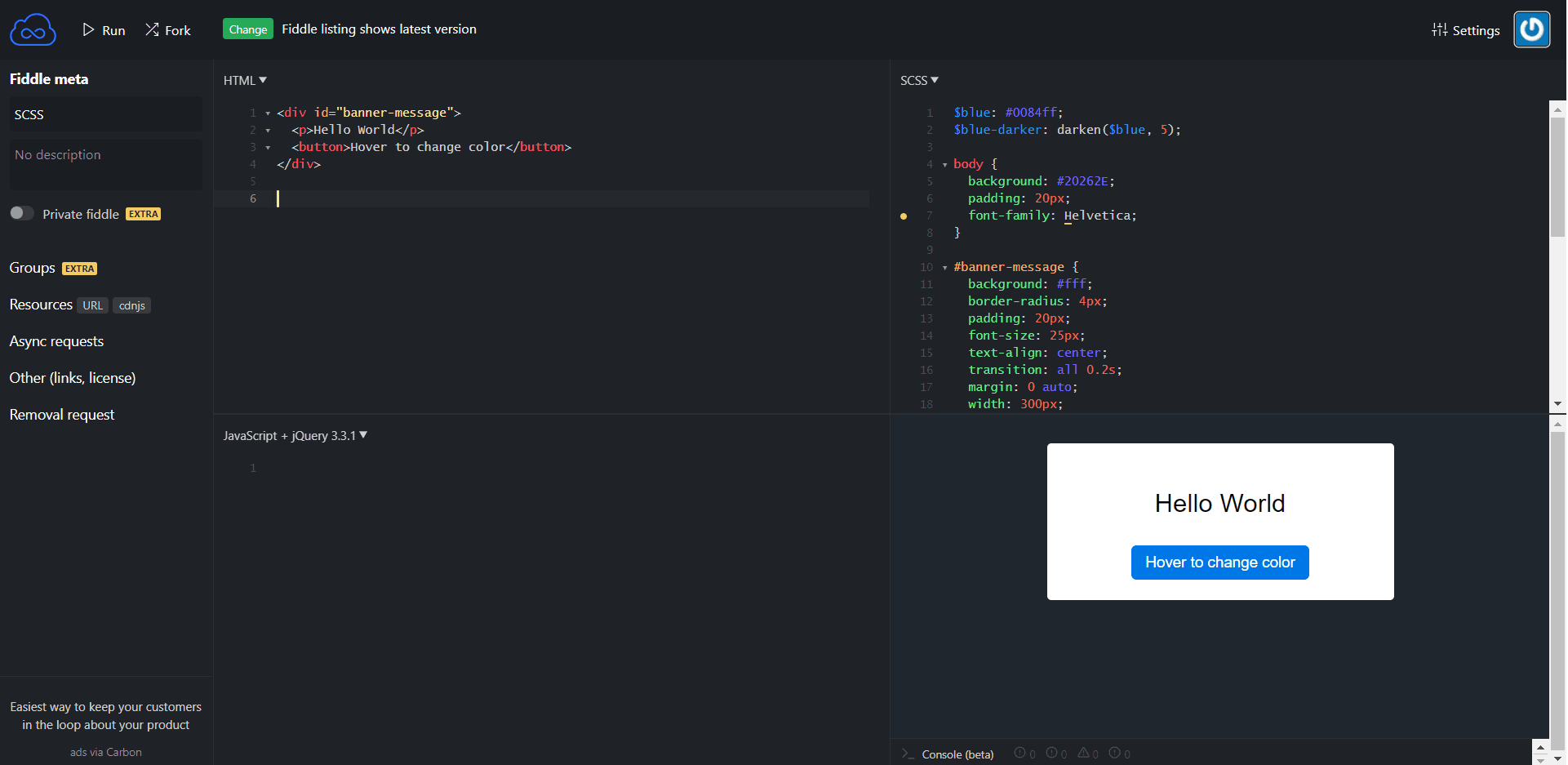

Что такое Whisper и как он используется в медицине

Whisper — это медицинский искусственный интеллект от компании Nabla, предназначенный для транскрипции разговоров между врачами и пациентами. Система уже расшифровала более 7 миллионов записей, и её активно используют более 30 тысяч врачей и 40 систем здравоохранения. В рамках работы над улучшением качества медуслуг такие технологии позволяют сократить время на документирование, что позволяет врачам уделить больше внимания пациентам. Однако недавние исследования выявили проблему, способную поставить под угрозу доверие к таким системам.

Галлюцинации ИИ: проблема, требующая решения

Исследователи из Корнелльского и Вашингтонского университетов обнаружили, что Whisper склонен к галлюцинациям. Проблема заключается в том, что примерно в 1% случаев ИИ добавляет в свои транскрипции абсурдные или полностью вымышленные фразы. Например, встречались выражения, которые не имели никакого смысла или не соответствовали реальному диалогу, включая упоминания о насилии и демографических стереотипах. Эти искажения особенно актуальны при транскрипции разговоров с пациентами, страдающими расстройствами речи, такими как афазия.

По словам Эллисон Кенеке из Корнельского университета, такие проблемы подчеркивают необходимость тщательного контроля за результатами работы ИИ в здравоохранении. Исходя из статистики, подобные искажения могут привести к неверной интерпретации контактной информации между врачами и пациентами, что в свою очередь может повлиять на качество медицинской помощи.

Меры по устранению проблем

Представители OpenAI, разработавшие Whisper, заявили, что они активно работают над решением данной проблемы. В частности, ограничивают использование данного ИИ в условиях, где высок риск, например, при принятии критически важных медицинских решений. تخصصы по использованию Whisper подчеркивают важность человеческого надзора и проверки информации, получаемой с помощью ИИ. Также в планах — внедрение дополнительных жеребьевых инструментов, которые помогут уменьшить уровень галлюцинаций.

Согласитесь, необходимость глубокого анализа данных и повышения точности интерфейсов становится критической, особенно в таких чувствительных сферах, как медицина. В заключение, важно помнить, что технологии, несмотря на свою мощь и потенциал, требуют разумного и осторожного подхода при обращении с данными, касающимися здоровья человека.

Перейти в телеграм, чтобы получить результаты теста

Перейти в телеграм, чтобы получить результаты теста

Забрать

Забрать

Добавить комментарий