Главное:

- Исследователи выяснили, что многие AI-модели, такие как OpenAI o1, страдают от недомышления.

- Модели часто ошибаются и теряют вычислительные ресурсы из-за слишком частых изменений стратегий.

- Новая метрика и метод «штрафа за переключение мыслей» могут повысить точность и стабильность моделей.

Проблема недомышления в AI

Недавние исследования, проведённые группами специалистов из Tencent AI Lab и университетов Сучжоу и Цзяо Тун, выявили серьезную проблему в работе AI-моделей, таких как о1 от OpenAI и Deepseek-R1. Оказалось, что эти модели часто не в состоянии справиться с трудными задачами, так как слишком быстро отклоняются от перспективных решений и переключаются между различными подходами. Это приводит к бесполезным затратам вычислительных ресурсов и снижению точности решений.

Модели, такие как QwQ-32B-Preview, демонстрируют неэффективное использование ресурсов, пробуя до 25 подходов к одной задаче. Исследования показали, что 70% неверных ответов содержат хотя бы одну правильную логическую цепочку, которая не была полностью исследована, что подтверждает наличие "недомышления".

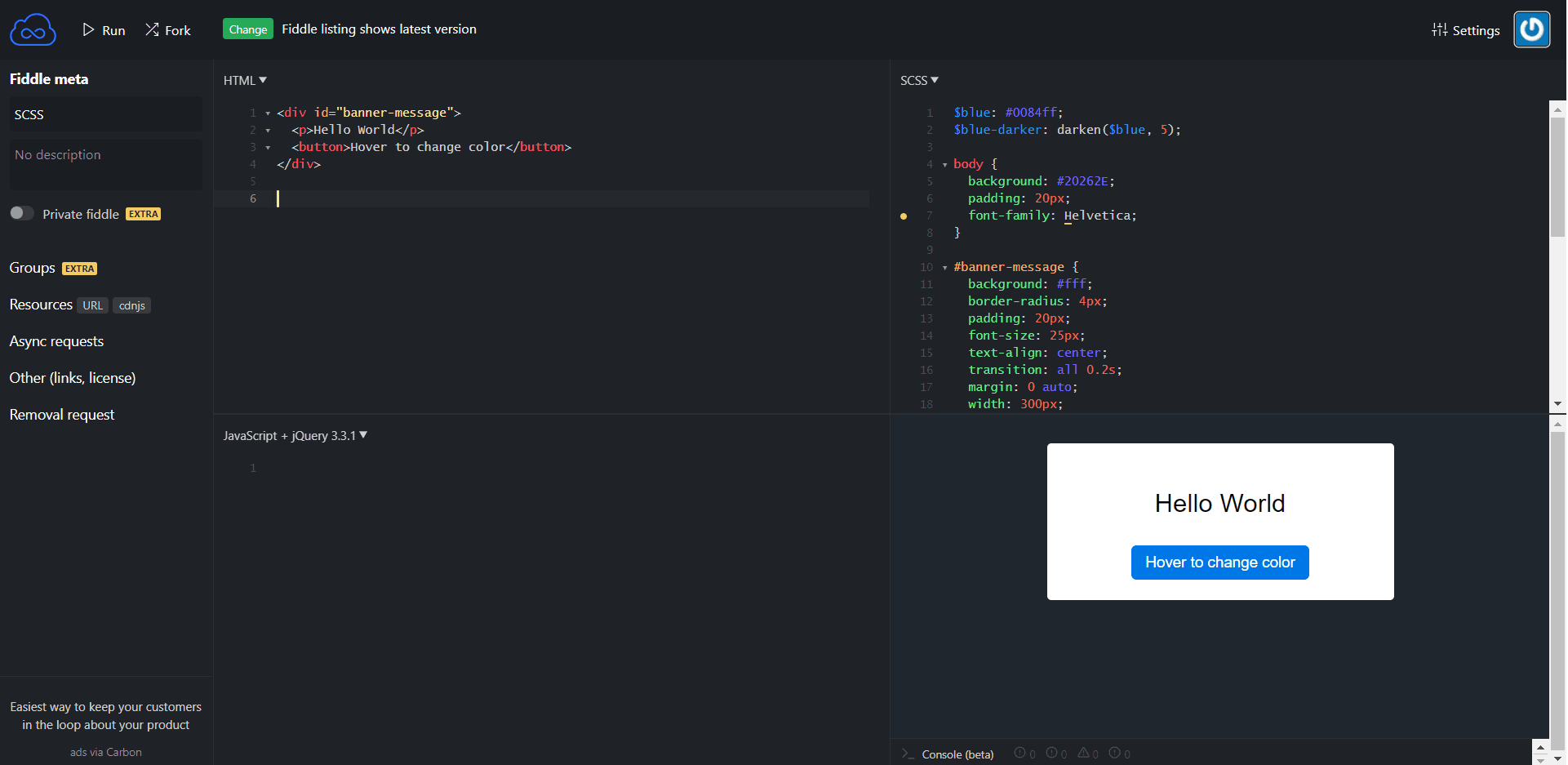

Влияние на вычислительные ресурсы

Согласно данным исследования, модели, которые предоставляют неправильные ответы, тратят на 225% больше вычислительных токенов и меняют стратегии на 418% чаще по сравнению с правильными ответами. Это указывает на плохую организованность процессов и неэффективность использования вычислительных мощностей. Для решения этой проблемы исследователи разработали новую метрику, которая оценивает эффективность использования токенов, посланных моделью в попытках найти правильное решение.

Интересно, что использование большего количества токенов не всегда приводит к большей точности ответов. Это означает, что качество рассуждений моделей не зависит исключительно от их мощности и объёма данных, а также от стратегии мышления.

Новые методы решения проблемы

Для борьбы с недостатками в процессе рассуждений была предложена методология «штрафа за переключение мыслей» (TIP), которая корректирует вероятности определённых токенов, используемых моделями. Когда модель рассматривает возможность смены стратегии, TIP накладывает штраф, что снижает вероятность перехода к другому подходу.

В результате применения метода TIP модель QwQ-32B-Preview показала значительные улучшения: точность её решений по задачам MATH500-Hard повысилась с 82,8 до 84,3%. Этот подход демонстрирует, что для достижения высокой эффективности AI-моделей важно не только наличие вычислительных мощностей, но и способность правильно управлять своим мышлением и адекватно реагировать на возникшие сложности в процессе решения задач.

Эти результаты открывают новые горизонты для дальнейших исследований в области искусственного интеллекта и его применения в решении сложных задач. Научные группы планируют продолжить работу, чтобы улучшить способности моделей к управлению собственным подходом к задаче и увеличить их устойчивость в условиях непростых интеллектуальных вызовов.

Перейти в телеграм, чтобы получить результаты теста

Перейти в телеграм, чтобы получить результаты теста

Забрать

Забрать

Добавить комментарий